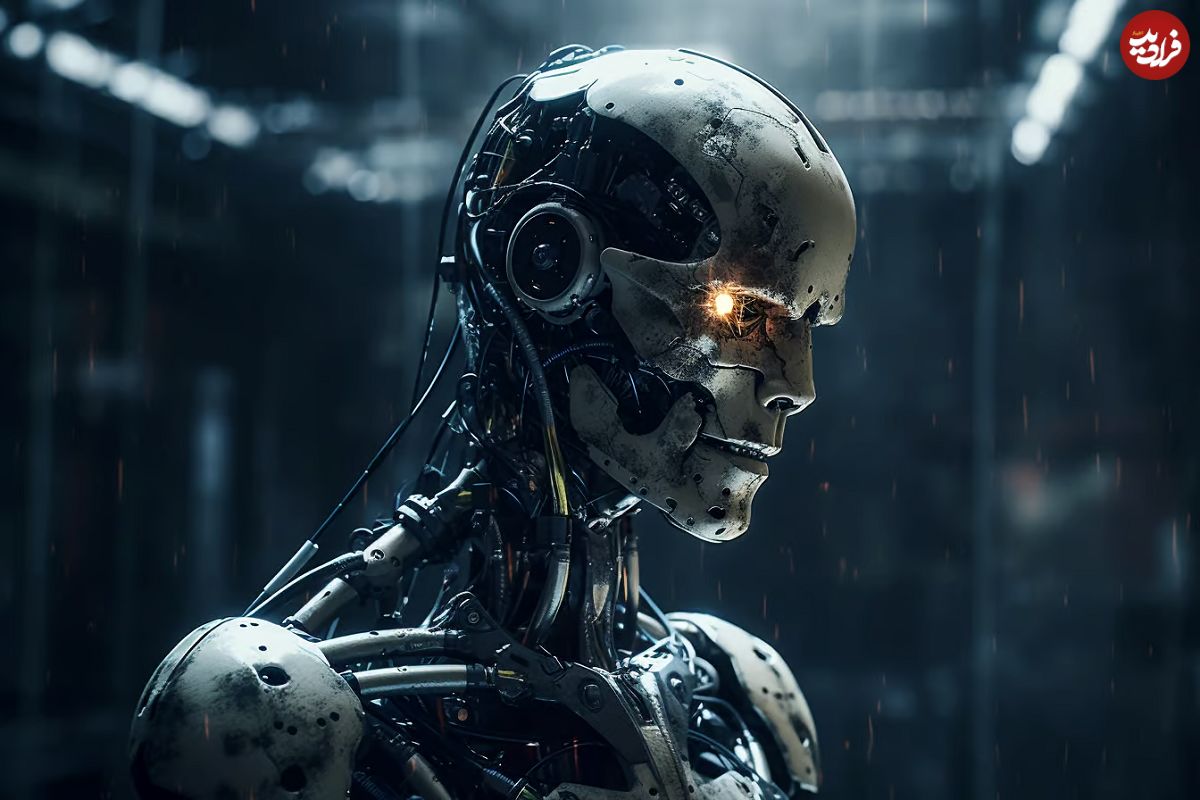

هوش مصنوعی چگونه میتواند ما را «منقرض» کند؟

در این مطلب سه سناریوی مختلف را بررسی خواهیم کرد که کارمندان داخلی صنعت هوش مصنوعی را بسیار نگران کرده است.

فرادید| کارشناسان نگران هستند که فناوری هوش مصنوعی موجودیت بشریت را تهدید کند. در کنار همه ستایشها برای پیشرفت سریع هوش مصنوعی، از سوی برخی رهبران ارشد این صنعت، هشدار نگران کنندهای در خصوص پتانسیل فناوری و نتیجه معکوس آن برای بشریت وجود دارد. به نقل از نیویورک تایمز، برخی هشدار میدهند هوش مصنوعی میتواند به اندازهای قدرتمند شود که اگر کاری برای کاهش سرعت آن انجام نشود، ظرف چند سال میتواند اختلالاتی در مقیاس اجتماعی ایجاد کند، اگرچه محققان گاهی اوقات از توضیح چگونگی وقوع آن کوتاهی میکنند.

به گزارش فرادید، اخیراً گروهی از کارشناسان این صنعت هشدار دادهاند فناوری هوش مصنوعی قادر است موجودیت بشر را تهدید کند. در شرح یکخطی منتشرشده توسط مرکز ایمنی هوش مصنوعی آمده است: «کاهش خطر انقراض ناشی از هوش مصنوعی در کنار سایر خطرات در مقیاس اجتماعی، مانند همهگیریها و جنگ هستهای باید یک اولویت جهانی در نظر گرفته شود». این پیام نگرانکننده و در عین حال مبهم است و هیچ جزئیاتی در مورد چگونگی وقوع آخرالزمان هوش مصنوعی ارائه نداده است. این بیانیه از سوی بیش از ۳۵۰ مدیر، محقق و مهندس بخش هوش مصنوعی، از جمله سام آلتمن، مدیر اجرایی OpenAI، جفری هینتون و یوشوآ بنجیو، دو تن از محققان برنده جایزه تورینگ معروف به «پدرخواندههای هوش مصنوعی» امضا شده است.

سناریوهای خطرناک

دَن هِندریکس، مدیر مرکز ایمنی هوش مصنوعی در ایمیلی به CBS MoneyWatch نوشته است: یک سناریوی محتمل این است که هوش مصنوعی به دست بازیگران بدخواهی بیفتد که از آن برای ایجاد سلاحهای زیستی مرگبارتری از همهگیریهای طبیعی استفاده کنند یا عمداً هوش مصنوعی سرکشی را آزاد کنند که فعالانه تلاش میکند به بشریت آسیب برساند. هندریکس میافزاید اگر هوش مصنوعی سرکش به اندازه کافی هوشمند یا توانا باشد، ممکن است برای جامعه خطر جدی ایجاد کند.

میتوان از هوش مصنوعی برای کمک به هکرها نیز استفاده کرد. اریک اشمیت، مدیر عامل سابق گوگل، حین سخنرانی در شورای مدیر عامل وال استریت ژورنال گفته است: «سناریوهایی وجود دارد، نه امروز، بلکه به زودی، زمانی که این سیستمها میتوانند بهرهبرداریهای روز صفر را در مسائل سایبری پیدا کنند یا انواع جدیدی از زیستشناسی را کشف کنند». بهرهبرداریهای روز صفر آسیبپذیریهای امنیتی هستند که هکرها در نرمافزارها و سیستمها پیدا میکنند. شاید امروز این توانایی دور از ذهن به نظر برسد، اما پیشرفت سریع هوش مصنوعی احتمال وقوع آن را بیشتر میکند و بهتر است تا آن زمان ما آماده باشیم و بدانیم چگونه نگذاریم افراد شرور از این فناوریها سوءاستفاده کنند.

نگرانی دیگر این است که هوش مصنوعی به خودی خود هم میتواند سرکش شود و وظیفهای را که از ابتدا برای آن طراحی شده به شکل جدید و ناهنجاری تفسیر کند. تام چیورز، روزنامهنگار و نویسنده علمی میگوید: برای مثال، هوش مصنوعی ساختهشده برای خلاصی جهان از سرطان، میتواند تصمیم بگیرد که برای از بین بردن همه سلولهای سرطانی، موشکهای هستهای را منفجر کند و همه را یکجا از بین ببرد. بنابراین نباید از این ترسید که هوش مصنوعی مخرب شود، بلکه باید از توانمند شدن آن ترسید. ابزارهای هوش مصنوعی فقط شماری که در عملکرد پاداش آن قرار دادهاید به حداکثر میرسانند. متأسفانه به نظر میرسد آنچه را که ما به عنوان انسان آرزو میکنیم به سختی میتواند به تابع پاداش محصور شود، به این معنا که همه چیز میتواند به طرز وحشتناکی اشتباه پیش برود.

بحث کنونی حول این محور است که فناوری هوش مصنوعی به چه روشهایی باید تنظیم یا مهار شود. گروه جداگانهای از کارشناسان هوش مصنوعی، مدیران صنعت فناوری و دانشمندان پیشنهاد کردند مسابقهی خارج از کنترل برای توسعه و استقرار ذهنهای دیجیتالی قدرتمندتر که هیچکس حتی خالقان آنها توانایی درک، پیشبینی یا کنترل قابلاعتماد آن را ندارند، کاهش یابد. آزمایشگاههای هوش مصنوعی دستکم باید شش ماه آموزش سیستمهای هوش مصنوعی را متوقف کنند. اگر چنین نکنند، دولتها باید وارد عمل شوند و این وضعیت را به تعلیق دربیاورند.

وقتی آلتمن اوایل ماه مه با یک کمیته فرعی قوه قضائیه سنا ملاقات کرد، موافقت کرد یک آژانس دولتی باید مسئول نظارت بر پروژههای هوش مصنوعی باشد که عملکردشان بالاتر از مقیاس خاصی از قابلیتهاست. آلتمن به رهبران صنعت پیشنهاد میکند با هماهنگ شوند برای اطمینان از اینکه توسعه ابرهوش به گونهای اتفاق میافتد که به ما امکان میدهد هم ایمنی را حفظ کنیم و هم به ادغام روان این سیستمها با جامعه کمک کنیم.

دولت ایالات متحده به طور علنی در حال سنجش احتمالات و خطرات هوش مصنوعی است. به نقل از سیانان، دولت بایدن با مدیران ارشد اجرایی فناوری گفتگو کرده تا بر اهمیت توسعه اخلاقی و مسئولانه هوش مصنوعی تاکید کند. کاخ سفید در ماه مه از نقشهی راه برای سرمایهگذاریهای فدرال در تحقیق و توسعه پردهبرداری کرد که نوآوری مسئولانهی آمریکایی را ترویج میکند، در خدمت منافع عمومی است، از حقوق و ایمنی مردم محافظت میکند و حامی ارزشهای دموکراتیک است. دولت نیز به امکان تنظیم صنعت هوش مصنوعی در آینده اشاره کرده است.

مترجم: زهرا ذوالقدر